「PubMedで論文は出てくるけれど、結局この治療法は効くの?効かないの?」

文献検索を始めたばかりのとき、そう感じたことはないでしょうか。

抄録を10本読んでも結論がバラバラで、結局Yes(効果あり)なのかNo(効果なし)なのか判断がつかない場面は、臨床現場では意外と多いはずです。

そこで活用したいのが、AI文献検索ツール「Consensus(コンセンサス)」です。

今回は、Consensusの基本操作(4ステップ)から、Consensus Meter・Pro Analysis・Study Snapshotsの3機能の使い分け、強みと限界、Elicit・PubMedとの役割分担まで、PT・OTが今日から使える形で解説します。

情報の信頼性について

・本記事はBRAIN代表/理学療法士の針谷が執筆しています(執筆者情報は記事最下部)。

・本記事はConsensus公式仕様(2026年4月時点)および、Consensus特化レビュー研究・AI文献検索ツール比較研究のデータを基に解説しています。

本記事の結論

- Consensusは2億件超の査読論文を対象に、Yes/No質問にAIで回答してくれる文献検索エンジン

- 4ステップで臨床疑問への回答(Yes/No%とエビデンス)が得られ、抄読会・症例検討・SDM資料作成に役立つ

- Consensus Meter・Pro Analysis・Study Snapshotsの3機能を目的別に使い分けると、エビデンス把握の効率が一気に上がる

- Consensus単独で文献検索を完結させない。PubMedによる厳密検索とElicitによる網羅検索と組み合わせるのが正解

以下、詳しく解説していきます。

Consensusとは?セラピストが使うべき3つの理由

Consensus(コンセンサス)は、2億件超の査読論文を対象に、Yes/No形式の臨床疑問にAIが直接回答してくれるAI文献検索エンジンです。

「○○は△△に効果があるか?」と質問すると、Yes(効果あり)とNo(効果なし)の論文を集計し、メーター表示で全体傾向を可視化してくれます。

2025年に学術誌Cureusに掲載されたConsensus特化レビューでは、ConsensusはPRISMAガイドラインに沿った検索手順をAIで自動化し、トピックレベル・論文レベルの両方で迅速な洞察を提供できると評価されています(Apata et al, 2025)。

セラピストの文献検索ワークフローで、Consensusが特に役立つのは以下の3つの場面です。

- Yes/No判定の素早い把握:「この介入は効果があるのか」を数十秒で確認したいとき

- SDM(共同意思決定)資料の準備:患者さんに介入の効果・限界を説明する前のたたき台作成

- 症例検討・抄読会の準備:研究全体の傾向(賛否のバランス)を視覚化したいとき

そして、Consensusの大きなメリットは「無料プランでも基本機能と月3回のDeep Searchが使える」ことです。

メールアドレスまたはGoogleアカウントを持っていれば、登録だけですぐに使い始められます。

※ EBPの基本的な考え方については、別記事「EBP/EBMとは|リハビリ臨床への活かし方|PT・OTのための実践ガイド」で詳しく解説しています。Consensusはエビデンス収集ステップを大幅に効率化します。

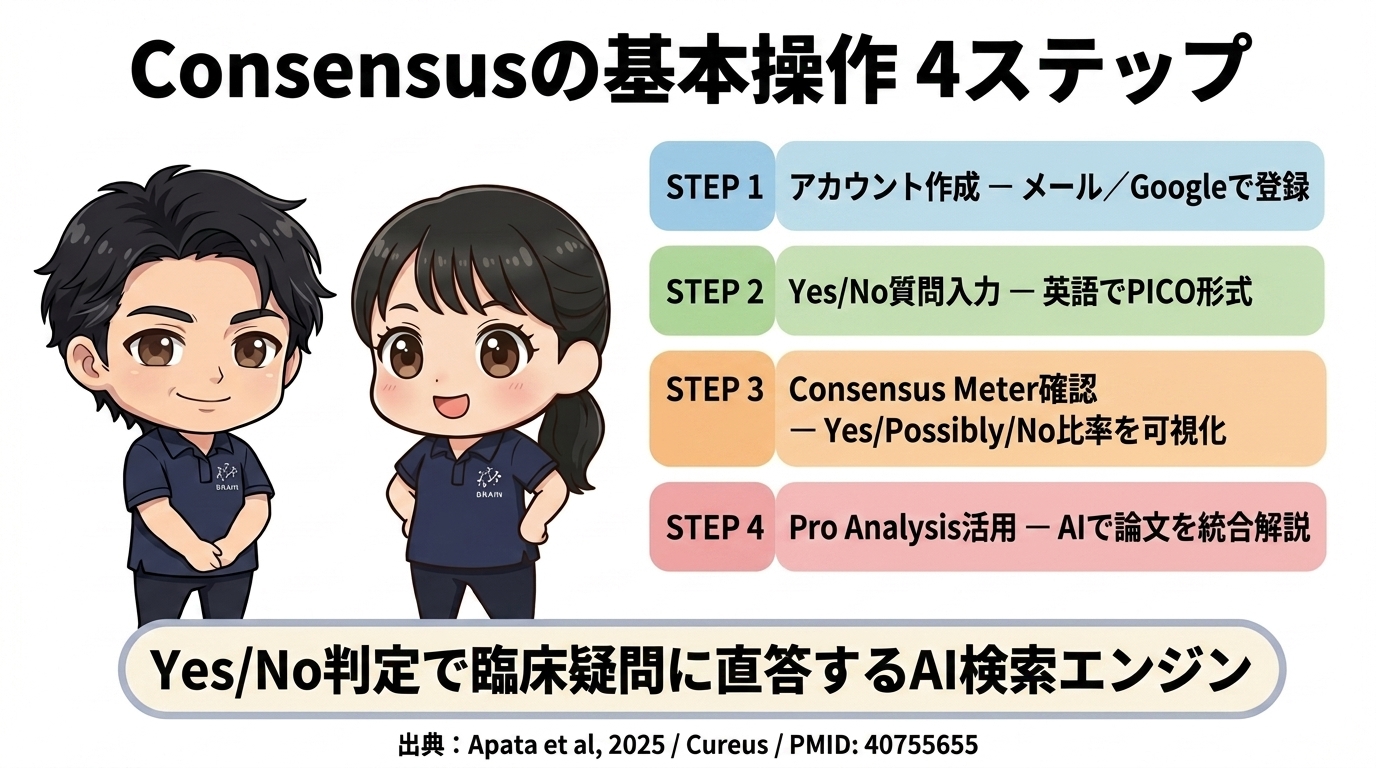

Consensusの基本操作|4ステップでYes/No判定を得る

Consensusを使い始める手順は、以下の4ステップです。

STEP1:アカウントを作成(メールまたはGoogleでログイン)

Consensusの公式サイト(https://consensus.app/)にアクセスし、「Sign up」ボタンを押します。

メールアドレスまたはGoogleアカウントの情報を入力すれば、すぐに使い始められます。

無料プランで月10回までのPro AnalysisとStudy Snapshots、月3回までのDeep Searchが使えます。

STEP2:Yes/No形式で臨床疑問を入力する(英語)

ログイン後の画面に、検索ボックスが表示されます。

Consensusは英語入力が前提なので、ChatGPTやDeepL翻訳・Google翻訳を使って臨床疑問を英訳しましょう。

Consensusで最も効果を発揮するのは、Yes/Noで答えられる質問形式です。

Does task-oriented training improve upper limb function in chronic stroke patients?

「○○は△△を改善するか?」「○○は安全か?」といった形式で入力すると、Consensus Meterが論文ごとのYes/Noを集計してくれます。

STEP3:Consensus Meterで全体傾向を確認する

検索結果ページの上部に「Consensus Meter」という独自の図表が表示されます。

これは、関連論文をAIが「Yes(支持)」「Possibly(可能性あり)」「No(不支持)」「Mixed(混合)」に分類し、割合を視覚化したものです。

例:Yes 70% / Possibly 20% / Mixed 10% のように表示され、研究全体の傾向が一目でわかります。

これがConsensus最大の特徴で、PubMedやElicitにはない独自機能です。

STEP4:Pro AnalysisとStudy Snapshotsで詳細を確認

Consensus Meterの下には、関連論文のリストが表示されます。

各論文に「Study Snapshot」(研究サマリー)が付き、研究デザイン・サンプルサイズ・主要結果が一目でわかります。

「Pro Analysis」を選ぶと、ChatGPT-4o級のLLMで複数論文を統合した詳細解説が生成されます。

この4ステップを踏むだけで、臨床疑問への「Yes/No判定」と「論文サマリー」を数分でつかめるのがConsensus最大の強みです。

Consensusの3機能の使い分け

Consensusには「Consensus Meter」「Pro Analysis」「Study Snapshots」の3つの主要機能があり、目的によって最適な機能が異なります。

Consensus Meter|研究全体の賛否バランスを可視化

Yes/No質問に対して、関連論文の結論をAIが自動分類し、メーター表示してくれる機能です。

例えば「task-oriented trainingは慢性期脳卒中患者の上肢機能を改善するか?」と聞くと、Yes 70%・Possibly 20%・Mixed 10%といった割合が表示されます。

研究の全体傾向を素早く把握したいとき、SDM資料に「研究の○%がYesと回答」と引用したいときに役立ちます。

Pro Analysis|複数論文を統合したAI解説

関連論文をChatGPT-4o級のLLMで統合し、詳細な解説文を生成する機能です。

「研究全体としてどのような知見があるか」を、自然な文章でまとめて読みたいときに使います。

無料プランでは月10回まで使用可能、Premium以上で無制限になります。

Study Snapshots|論文ごとの研究サマリー

各論文に対して、研究デザイン・サンプルサイズ・主要結果を一覧表示する機能です。

抄読会で論文を選定するとき、論文の質を素早く判断したいときに使います。

無料プランでは月10回まで利用可能です。

※ Google ScholarとPubMedの違いについては、別記事「Google ScholarよりもPubMedを使うべき3つの理由」で詳しく解説しています。

Consensusの料金プラン|無料・Premium・Pro・Deep

Consensusの料金プランは2026年4月時点で以下の通りです。

- 無料プラン:基本検索+Pro Analysis 10回/月+Study Snapshots 10回/月+Deep Search 3回/月

- Premium:$8.99/月(年払いで$108)。Pro AnalysisとStudy Snapshotsが無制限

- Pro:$15/月(年払いで$120)。Premium機能+Deep Search 15回/月

- Deep:パワーユーザー・研究者向け。Pro機能+Deep Search 200回/月

- Teams:$9.99/seat/月。チーム単位で利用

セラピストが個人で使うなら、まずは無料プランで月3回のDeep Searchを臨床疑問の検証に使うのが現実的です。

抄読会の主担当・症例レポート執筆など、頻繁に使う場合はPremium($8.99/月)が費用対効果が高い選択肢になります。

Consensusの強みと限界|AIに頼り切ってはいけない理由

Consensus最大の強みは、「Yes/No質問に対する研究全体の賛否バランスを数十秒で可視化できる」点にあります。

SDM資料の準備、抄読会・症例検討の論文選定で、極めて便利です。

ただし、Consensusには明確な限界があり、最近のAI文献検索ツール比較研究で具体的に報告されています。

限界①:参考文献の捏造(fabrication)リスクが残る

2026年にClinical Gastroenterology and Hepatology誌に発表されたAI研究ツール比較研究では、Elicit・Consensusのような専用AI研究プラットフォームについて、汎用LLMよりは低いものの参考文献の捏造リスクが残り、すべての出力で独立した検証が必須と指摘されています(Gainey et al, 2026)。

Consensusが提示する論文サマリー・引用文をそのまま信じず、必ず元論文を開いて確認することが必須です。

限界②:学術文献での使用報告がまだ少ない

2025年にCureus誌に発表されたConsensus特化レビューでは、PRISMA準拠で210データベースを横断検索した結果、Consensus Appに関する論文はわずか10件に留まり、研究現場での利用報告が極めて少ない状況が明らかになりました(Apata et al, 2025)。

これは「Consensusが信頼できない」という意味ではなく、「臨床研究での標準ツールとして確立されておらず、報告ガイドラインも未整備」という意味です。

論文・学会発表でConsensusの結果を引用する場合は、検索日・検索式・Consensus Meterの数値を明記する透明性が求められます。

限界③:標準化された記述スタイルに偏る傾向がある

2025年にBrazilian Dental Journalに発表されたAIツール比較研究では、Elicit・Perplexity・Consensus・ChatGPT・Grammarlyを比較し、Consensusを含むAI出力は技術的不正確さや過度に標準化された記述スタイルといった限界を抱えると報告されています(Granjeiro et al, 2025)。

Consensusの解説文をそのままコピペで使うと、文章のクセが似通ってしまい、独自の臨床的考察が薄まる恐れがあります。

2025年にResearch Synthesis Methods誌で発表された生成AI×SR研究の系統的レビューでは、19研究の解析から生成AIは検索段階で68〜96%(中央値91%)の論文を取り逃し、誤除外率は1〜83%(中央値28%)と報告されています(Clark et al, 2025)。

つまり、AIツール全般に「論文の取り逃し」と「誤除外」のリスクがあるため、人間によるダブルチェックは必須です。

関連する内部記事として「有料の英語論文を無料で入手する4つの方法」も併せて参照すると、Consensusで見つけた論文を効率的に全文入手できます。

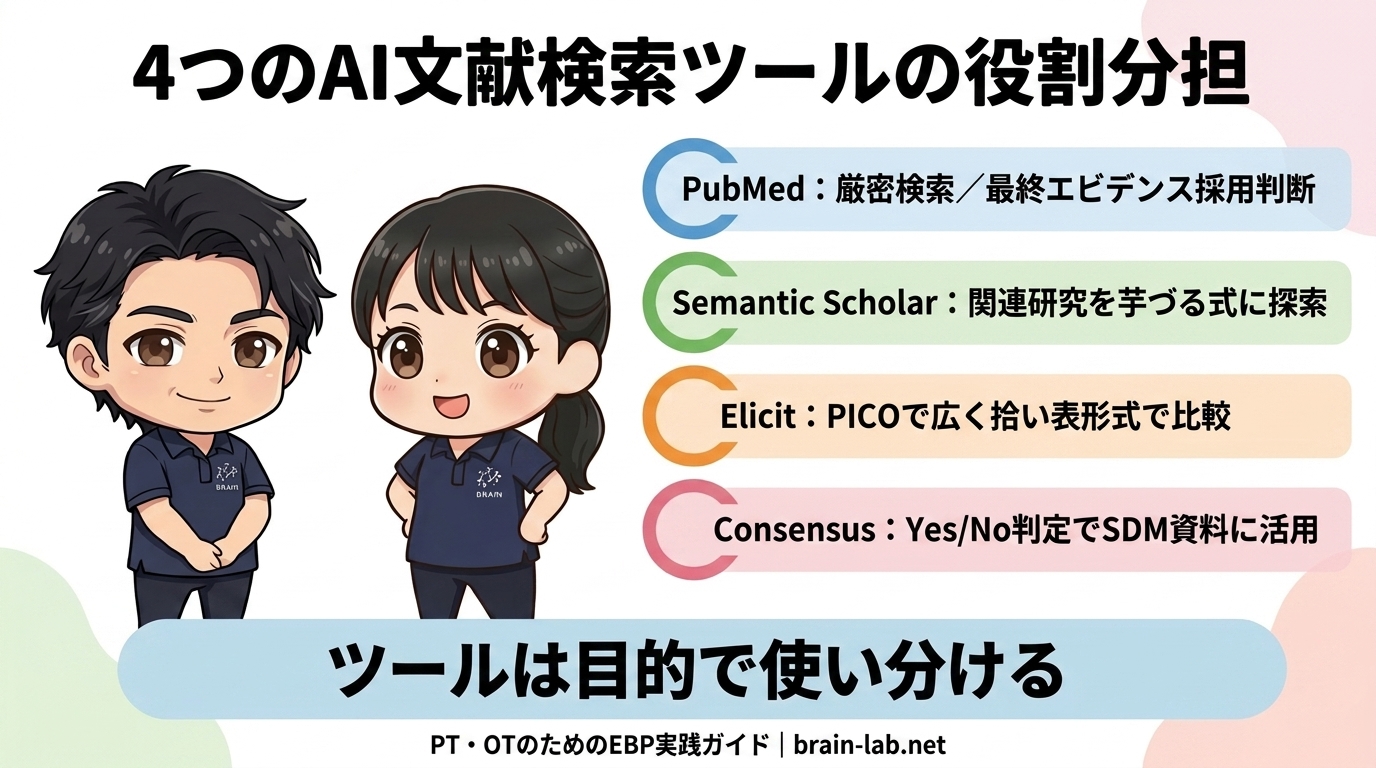

Elicit・PubMed・NotebookLMとの使い分け|文献検索ワークフローの全体像

「Consensusだけで全部できるのでは?」と思いがちですが、Elicit・PubMed・NotebookLMにはそれぞれ得意領域があります。

4つのツールは「使う場面が違う」ので、どれか1つに絞るのではなく、用途に応じて使い分けるのが正解です。

- Consensus:Yes/No判定に使う(介入の効果有無を素早く把握、SDM資料用)

- Elicit:研究の傾向・方向性確認に使う(PICOから関連論文を広く拾い、対象・方法・結果を表形式で比較)

- PubMed:厳密な検索式で網羅的に集める(最終的なエビデンス採用判断はここで行う)

- NotebookLM:手元の文献を深く読み込む(PubMedで集めた論文の1次・2次スクリーニング、データ抽出、批判的吟味)

つまり、文献検索ワークフローの「Yes/No判定:Consensus」「広く拾う:Elicit」「厳密検索:PubMed」「深く読む:NotebookLM」と役割を分担すると、効率が一気に上がります。

2025年にBrazilian Dental Journalに発表されたAIツール比較研究でも、Elicit・Perplexity・Consensus・ChatGPT・Grammarlyのそれぞれが文献分析ワークフローの異なる段階で機能を発揮することが報告されています(Granjeiro et al, 2025)。

各ツールの具体的な使い方は、別記事で詳しく解説しています:

→ Elicitの使い方|AIで関連文献を一気に把握する4ステップ|PT・OT実践ガイド

→ NotebookLMで論文を読む|PT・OTのスクリーニング負担を5分の1にする活用ガイド

→ PubMedの使い方|PT・OTのための完全ガイド|検索手順を初心者向けに解説

BRAINでのConsensus活用事例|SDM資料準備での使い方

BRAIN(株式会社BRAINが運営する脳卒中専門リハビリ施設)でも、Consensusをセラピスト全員で活用しています。

具体的には、以下のような使い方をしています。

- SDM(共同意思決定)資料の準備:BMI・TMS・TOT-Sなど介入候補の効果有無を、Consensus Meterで患者さんに視覚的に提示する

- 抄読会の論文選定:「○○は効果があるか?」というYes/No質問で関連論文を素早く一覧化する

- 新人セラピスト教育:「臨床疑問→Yes/No判定」のプロセスを実演し、EBPの基本動作を体感させる

特に重要な運用ルールは、Consensus Meterの数値はあくまで「研究全体の傾向」であり、個別患者への適用判断はセラピストが行うという点です。

2025年にValue in Health誌に発表された生成AI×SR研究の系統的レビューでは、30研究の解析から、生成AIはPICO策定・データ抽出には有効だが、文献検索・研究選択での単独運用は非推奨と結論されています(Rashid et al, 2025)。

この知見は、BRAINでの「ConsensusはSDM準備の下調べ、最終判断はセラピスト」という運用方針の科学的裏付けになっています。

よくある質問(FAQ)

Q1:Consensusは完全無料で使えますか?

無料プランでも基本検索とPro Analysis 10回/月、Study Snapshots 10回/月、Deep Search 3回/月が使えます。

有料プラン(Premium $8.99/月、Pro $15/月)にすると、Pro AnalysisとStudy Snapshotsが無制限になり、Deep Searchの回数も増えます。

まずは無料プランで試してみて、業務に使えるか確認してから有料化を検討するのがおすすめです。

Q2:日本語で臨床疑問を入力してもいいですか?

原則として英語入力が前提です。

UIは100以上の言語に対応していますが、Consensusの検索基盤となる論文は英語論文(特にPubMed掲載論文)が中心のため、英語クエリの方が圧倒的に精度が高くなります。

ChatGPTやDeepL翻訳を使って臨床疑問を英訳してから入力しましょう。

Q3:ConsensusとElicitはどちらを先に使うべきですか?

用途によって順番が変わります。

「効果の有無を素早く判断したい」場合は、Consensus→PubMedの順がおすすめです。

「研究の対象・方法・結果を表形式で比較したい」場合は、Elicit→PubMedの順が有効です。

システマティックレビューや臨床ガイドライン作成では、Consensus・Elicit単独では感度が不足するため、必ずPubMedを併用してください。

Q4:Consensus Meterの数値(Yes 70%など)はそのまま患者説明に使っていいですか?

そのまま使う前に、必ず元論文を確認してください。

2026年のAI研究ツール比較研究では、Consensusのような専用AIプラットフォームでも参考文献の捏造リスクが残ることが報告されています(PMID 41935592)。

Consensus Meterの数値は「研究全体の傾向の参考値」と捉え、患者説明に使う場合は元論文の研究デザイン・対象患者・効果量を確認した上で根拠とともに提示するのが大原則です。

Q5:施設のセキュリティポリシーで使えるか不安です

所属施設の情報システム部門・コンプライアンス担当に必ず事前確認してください。

Consensusに入力するのは「臨床疑問」(公開済みの研究テーマ)であり、患者個人情報を含めなければ問題ない施設が多いですが、施設ごとにポリシーが異なるため確認は必須です。

カルテ情報・患者氏名・生年月日などの個人情報は、絶対に入力しないでください。

本記事のまとめ

- Consensusはメールアドレスだけで無料利用できる、Yes/No判定に特化したAI文献検索エンジン

- 4ステップ(アカウント作成→Yes/No質問入力→Consensus Meter確認→Pro Analysis/Study Snapshots活用)で研究全体の賛否バランスを数十秒で把握できる

- Consensus Meter・Pro Analysis・Study Snapshotsの3機能を目的別に使い分けることで、SDM準備・抄読会・症例検討の効率が一気に上がる

- Consensus単独では参考文献の捏造リスク・標準化された記述スタイルの限界があるため、PubMedによる厳密検索とElicitによる網羅検索と組み合わせ、最終判断は人間が行うのが大原則

本記事の内容が、エビデンスをYes/Noで素早く把握したい・SDM資料を効率的に作りたいセラピストの役に立てましたら幸いです。

参考文献

Apata OE, Kwok OM, Lee YH. The Use of Generative Artificial Intelligence (AI) in Academic Research: A Review of the Consensus App. Cureus. 2025;17(7):e87297. PMID: 40755655

Granjeiro JM, Cury AADB, Cury JA, et al. The future of scientific writing: AI tools, benefits, and ethical implications. Braz Dent J. 2025;36:e256471. PMID: 40197923

Gainey CS, Shroff H, Fix OK. Artificial intelligence tools for GI research: a practical guide. Clin Gastroenterol Hepatol. 2026. PMID: 41935592

Clark J, Barton B, Albarqouni L, et al. Generative artificial intelligence use in evidence synthesis: a systematic review. Res Synth Methods. 2025. PMID: 41626912

Rashid M, Yi CS, Sathapanasiri T, et al. Role of generative artificial intelligence in assisting systematic review process in health research: a systematic review. Value Health. 2025. PMID: 40848037

Bernard N, Sagawa Y, Bier N. Using artificial intelligence for systematic review: the example of Elicit. BMC Med Res Methodol. 2025. PMID: 40102714

Lau O, Golder S. Comparison of Elicit AI and traditional literature searching in evidence syntheses using four case studies. Cochrane Evid Synth Methods. 2025. PMID: 41035533

Sanghera R, Thirunavukarasu AJ, El Khoury M, et al. High-performance automated abstract screening with large language model ensembles. J Am Med Inform Assoc. 2025. PMID: 40119675

Hempel S, Sysawang K, Holmer HK, et al. Using large language models to address contextual questions in systematic reviews. Cochrane Evid Synth Methods. 2026. PMID: 41767019

Helms Andersen T, Marcussen TM, Termannsen AD, et al. Using artificial intelligence tools as second reviewers for data extraction in systematic reviews. Cochrane Evid Synth Methods. 2025. PMID: 40661122

BRAINアカデミー

エビデンスに基づく脳卒中リハビリテーションを体系的・網羅的に学ぶ、3ヶ月間のオンライン学習プログラムです。①動画教材 ②課題 ③フィードバックを通じて、EBMを身に付けましょう!

詳細はこちら