「Elicit・Consensus・Perplexity・Semantic ScholarでAI文献検索が一気にラクになった。これだけで臨床判断していいのでは?」

AI文献検索ツールが普及した2026年、そう感じているPT・OTは少なくないはずです。

しかし、近年のシステマティックレビューでは、生成AIによる文献検索は中央値91%の論文を取り逃し、誤除外率は中央値28%に達することが報告されています(Clark et al, 2025)。

つまり、AIだけに頼って臨床判断すると、本来採用すべき論文の大半を見逃したまま「これがエビデンスです」と患者さんに説明してしまうリスクがあるということです。

今回は、Elicit・Consensus・Perplexity・Semantic ScholarなどのAI文献検索ツールに共通する7つの落とし穴をPubMed掲載研究の数値で示し、PT・OTが「便利さ」と「安全性」を両立するための運用フレームワークを解説します。

情報の信頼性について

・本記事はBRAIN代表/理学療法士の針谷が執筆しています(執筆者情報は記事最下部)。

・本記事はPubMed掲載のAI文献検索ツール評価研究・生成AI×システマティックレビュー研究のデータを基に、PT・OT向けに再編集しています。

本記事の結論

- AI文献検索ツールには7つの普遍的な落とし穴があり、すべての主要ツールに共通する

- 最大のリスクは「論文の取り逃し91%」と「誤除外28%」で、AI単独では本来採用すべきエビデンスを大量に見逃す

- PT・OTがAIを安全に使う鍵は、「リスク階層化フレームワーク」で工程ごとに人間判断を必須化すること

- BRAINでは「AIはセカンドレビュアー、最終判断はセラピスト」を運用ポリシーに据え、患者説明・SDM資料・抄読会のすべてで原文確認を必須化している

以下、詳しく解説していきます。

なぜ「AI文献検索だけ」に頼ると危険なのか

「Elicit・Consensus・Perplexityで論文を集めれば、もうPubMedは要らないのでは?」

そう感じる気持ちはよくわかります。AIは確かに便利で、数十秒で関連論文の要点をまとめてくれます。

しかし、PT・OTが患者さんに「このリハビリは効果があります」と説明するとき、その根拠が「AIが要約した1段落」だけで本当にいいでしょうか。

2025年にResearch Synthesis Methods誌に発表された生成AI×システマティックレビュー研究の系統的レビューでは、19研究の解析から生成AIは検索段階で68〜96%(中央値91%)の論文を取り逃し、誤除外率は1〜83%(中央値28%)と報告されています(Clark et al, 2025)。

これは「AIで100本ヒットしたとしても、本来1,000本以上ある論文の大半を見逃している」という意味です。

2025年にValue in Health誌に発表された30研究のSRでも、生成AIはPICO策定・データ抽出には有効だが、文献検索・研究選択での単独運用は非推奨と結論されています(Rashid et al, 2025)。

つまり、AI文献検索は「下調べツール」としては優秀でも、「最終判断ツール」として使うと臨床上のリスクを抱えるということです。

※ EBPの基本的な考え方については、別記事「EBP/EBMとは|リハビリ臨床への活かし方|PT・OTのための実践ガイド」で詳しく解説しています。AIはEBPプロセスを加速できますが、最終判断は常にセラピストの専門的判断と患者の価値観で決まります。

AI文献検索ツールに共通する7つの落とし穴

Elicit・Consensus・Perplexity・Semantic Scholar・ChatGPT・Geminiなど、ほぼすべてのAI文献検索ツールに共通する落とし穴は7つに整理できます。

いずれもPubMed掲載の評価研究で具体的な数値とともに報告されています。

落とし穴①:論文の取り逃し(中央値91%)

2025年の19研究SRで、生成AIは検索段階で68〜96%(中央値91%)の論文を取り逃すと報告されました(Clark et al, 2025)。

個別ツールでも、Elicit Proの感度は4件SR平均39.5%(25.5〜69.2%)にとどまり、従来検索(94.5%)を大きく下回ったことが示されています(Lau & Golder, 2025)。

対策:AIで集めた論文だけで結論を出さず、必ずPubMedで検索式を組んで網羅検索を行う。

落とし穴②:誤除外(中央値28%)

同じ19研究SRで、生成AIの誤除外率(本来採用すべき論文を間違って除外する率)は1〜83%(中央値28%)と報告されました(Clark et al, 2025)。

「AIが除外した論文=関係ない論文」と思い込むと、本来は重要な研究を見落とす危険があります。

対策:AIで除外された論文も、タイトル・抄録だけは目視で確認する。スクリーニングは必ず人間とのダブルチェック体制で行う。

落とし穴③:参考文献の捏造(hallucination)リスク

2026年にClinical Gastroenterology and Hepatology誌に発表されたAI研究ツール比較研究では、Elicit・Consensusのような専用AI研究プラットフォームでも、汎用LLMよりは低いものの参考文献の捏造リスクが残り、すべての出力で独立した検証が必須と指摘されています(Gainey et al, 2026)。

AIが提示した「PMID 12345678」が実在しない、または別の論文のPMIDを誤って引用するケースが報告されています。

対策:AIが提示したすべての引用について、PubMedで検索して実在を確認する。著者名・タイトル・年が合致するかチェックする。

落とし穴④:数値抽出の不正確さ

2025年にCochrane Evidence Synthesis and Methods誌に発表された20件のRCTでのデータ抽出比較研究では、研究目的・対象特性・介入内容では人間と概ね一致したものの、介入効果の数値抽出(効果量・p値・信頼区間)では人間の方が正確と報告されています(Bianchi et al, 2025)。

AIが「FMA改善6.2点」と要約していても、原文では「FMA改善2.6点」と書かれているケースが起こり得ます。

対策:論文の核心となる数値(効果量・p値・MCID・サンプルサイズ)は、必ず原文(特にResults / Tables)を開いて確認する。

落とし穴⑤:地域固有用語・診療文化に弱い

2026年にJournal of Medical Imaging and Radiation Oncology誌で発表されたPerplexity・ChatGPT・Geminiの3LLM比較研究では、地域固有の医療用語(西オーストラリア固有の制度・施設名など)を含む質問では、Perplexity・Geminiで不適切な回答が増加すると報告されています(Njunge et al, 2026)。

日本のセラピストが使う場合、「介護保険」「リハビリテーション科」「診療報酬」など日本特有の制度・用語では、米国・英国の文脈で回答が生成される可能性があります。

対策:日本固有の制度・診療文化に関する情報は、Mindsガイドライン・厚生労働省資料・日本のリハビリ学会の声明で必ず裏取りする。

落とし穴⑥:標準化された記述スタイルへの偏り

2025年にBrazilian Dental Journalに発表されたAIツール比較研究(Elicit・Perplexity・Consensus・ChatGPT・Grammarly)では、AI出力は技術的不正確さや過度に標準化された記述スタイルといった限界を抱えると指摘されています(Granjeiro et al, 2025)。

AIの解説文をそのままコピペで使うと、文章のクセが似通ってしまい、独自の臨床的考察が薄まります。

対策:AIの出力は「下書き」と捉え、自分の臨床経験・施設の患者特性・SDMでの患者反応を踏まえて必ず加筆・編集する。

落とし穴⑦:プロンプトの工夫なしには品質が上がらない

2026年にJournal of the American College of Clinical Pharmacy誌に発表された6種AIツール比較研究(Perplexity・Gemini・ChatGPT・Copilot・Llama・Claude)では、広範な初期プロンプトではすべてのツールが「曖昧・不完全・不正確」な回答となり、セクション別の絞り込みプロンプトで初めて品質が向上すると結論されました(Sibbesen et al, 2026)。

「○○について教えて」と漠然と聞くだけでは、表層的な回答しか得られません。

対策:PICO形式で具体化する/対象・介入・比較・アウトカムを分けて聞く/検索条件(言語・年代・研究デザイン)を明示する。

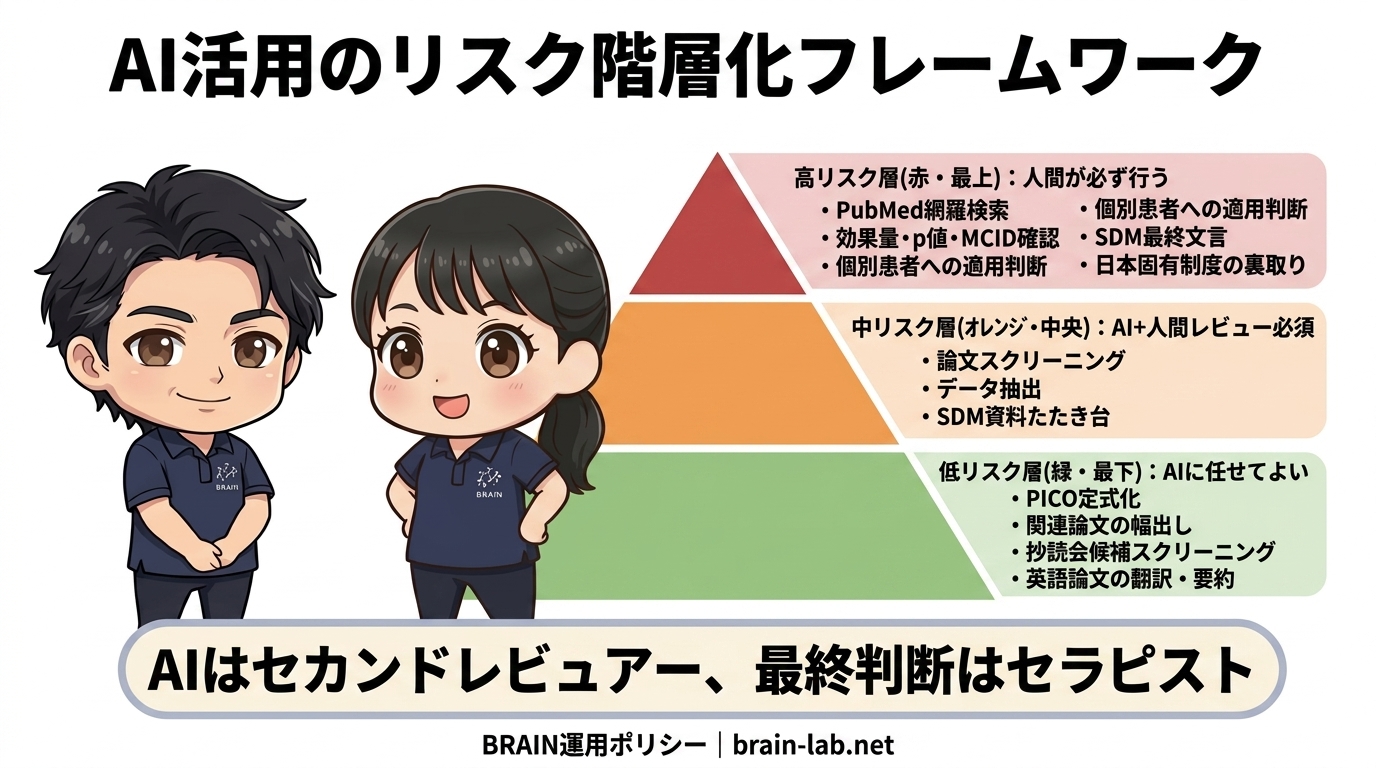

PT・OTのためのリスク階層化フレームワーク

「7つの落とし穴があるなら、AIは使わないほうがいいのでは?」

そう感じるかもしれませんが、答えは「No」です。

正解は、「AIに任せていい工程」と「人間が必ず行う工程」を分け、リスクの大きい判断ほど人間チェックを必須化することです。

BRAINでは、以下の3層構造でAI活用を運用しています。

低リスク層(AIに任せてよい工程)

- 臨床疑問のPICO定式化(ChatGPT・Perplexity)

- 研究テーマの全体像把握・関連論文の幅出し(Elicit・Semantic Scholar)

- 抄読会候補論文のスクリーニング(NotebookLM・Consensus)

- 英語論文の翻訳・要約(ChatGPT・DeepL)

中リスク層(AI出力+人間レビュー必須の工程)

- 論文のスクリーニング(人間とAIのダブルチェック)

- 研究デザイン・対象特性のデータ抽出(AI下書き+人間検証)

- SDM資料のたたき台作成(AI出力+臨床経験で加筆)

2025年にCochrane Evidence Synthesis and Methods誌に発表された研究では、3件のSR・30論文でElicitとChatGPTを「セカンドレビュアー」として人間と比較し、人口統計・研究デザインの抽出では高い一致率を示すことが報告されています(Helms Andersen et al, 2025)。

高リスク層(人間が必ず行う工程)

- PubMedでの厳密な網羅検索(最終的なエビデンス採用判断)

- 効果量・p値・MCID・信頼区間の確認(必ず原文・Table参照)

- 個別患者への適用判断(年齢・併存疾患・価値観の照合)

- SDM・患者説明の最終文言(標準化文章を超えた個別化)

- 日本固有の制度・診療文化に関する情報の裏取り

2026年にCochrane Evidence Synthesis and Methods誌に発表された研究でも、AHRQ EPCの25件SERでLLMが「文脈質問への回答」では実用的だが、「研究選択」では人間と並走させる必要があると報告されています(Hempel et al, 2026)。

BRAINの運用ポリシー|AIを「セカンドレビュアー」として位置づける

BRAIN(株式会社BRAINが運営する脳卒中専門リハビリ施設)では、AI文献検索ツールを「セカンドレビュアー」として位置づけています。

具体的な運用ルールは以下の3つです。

- ルール①:AIで集めた論文は必ずPubMedで実在確認する(PMID・著者・年の一致を確認)

- ルール②:効果量・p値・MCIDなど数値は必ず原文のResults / Tablesで確認する

- ルール③:SDM資料・患者説明文は、AI下書き+セラピストの加筆+施設内ピアレビューで完成させる

このポリシーは、最近のシステマティックレビュー研究の知見と一致しています。

2025年にCochrane Evidence Synthesis and Methods誌に発表されたElicit Pro検証研究では、Elicitの感度は平均39.5%にとどまり、「単独でのSRには感度不足、補助ツール扱いが妥当」と結論されています(Lau & Golder, 2025)。

2025年の20件RCTデータ抽出比較研究でも、研究目的・対象特性は人間と概ね一致したものの、介入効果の数値抽出では人間の方が正確と報告されています(Bianchi et al, 2025)。

つまり、「AIで下調べ→PubMedで網羅検索→人間が最終判断」という3段階フローが、現時点で最も科学的に支持される運用です。

PT・OTのためのツール選定マップ|目的別の使い分け

主要なAI文献検索ツールには、それぞれ得意領域があります。

用途に応じて使い分けるのが、最も効率的かつ安全です。

- PubMed:厳密な網羅検索(最終的なエビデンス採用判断)— AI時代でも「主役」

- Elicit:PICOから関連論文を広く拾い、対象・方法・結果を表形式で比較

- Consensus:Yes/No判定でSDM資料に活用(Consensus Meterで賛否バランスを可視化)

- Semantic Scholar:1本の論文から関連研究を芋づる式に探索(Citation Graph)

- Perplexity:出典付きAI回答エンジン(ガイドライン・最新ニュース確認)

- NotebookLM:手元の論文を深く読み込む(スクリーニング・データ抽出・批判的吟味)

各ツールの具体的な使い方は、別記事で詳しく解説しています:

→ PubMedの使い方|PT・OTのための完全ガイド|検索手順を初心者向けに解説

→ Elicitの使い方|AIで関連文献を一気に把握する4ステップ|PT・OT実践ガイド

→ Consensusの使い方|Yes/No判定とConsensus MeterでEBPを加速する4ステップ

→ Semantic Scholarの使い方|TLDR要約と引用ネットワークで関連論文を芋づる式に探す

→ Perplexityの使い方|出典付きAI回答エンジンで臨床疑問を即座に解決する4ステップ

→ NotebookLMで論文を読む|PT・OTのスクリーニング負担を5分の1にする活用ガイド

PubMedの基本ができていない状態でAIだけ使うと、7つの落とし穴に直撃します。

「AIは下調べ→PubMedで仕上げ」が、2026年現在の最適解です。

関連する内部記事として「有料の英語論文を無料で入手する4つの方法」も併せて参照すると、AIで見つけた論文を効率的に全文入手できます。

よくある質問(FAQ)

Q1:AIだけでも臨床判断できるレベルまで進化していますか?

2026年4月時点では、できません。

2025年の19研究SRで、生成AIは中央値91%の論文を取り逃すと報告されています(PMID 41626912)。

個別の臨床判断・SDM・患者説明は、必ずPubMed検索+セラピストの専門的判断と組み合わせる必要があります。

Q2:複数のAIツールを使い分ける時間が取れません。1つだけ選ぶならどれですか?

用途によって異なりますが、PT・OTが「最初の1つ」として選ぶならElicitが現実的です。

無料プランで関連論文の表形式比較ができ、PICO形式の臨床疑問に最適化されているためです。

ただし、Elicitだけで完結させず、必ずPubMedで網羅検索を行うことが必須です。

Q3:AIの誤りに気づくにはどうすればよいですか?

3つのチェックポイントがあります。

- PMID実在確認:AIが提示したPMIDをPubMedで検索し、著者・タイトル・年が一致するか

- 数値ファクトチェック:効果量・p値・サンプルサイズを原文Tableで確認する

- 地域・診療文化の整合性:日本のリハビリ現場での実情と矛盾していないか

Q4:AIに患者情報を入力してもいいですか?

絶対に入力しないでください。

カルテ情報・患者氏名・生年月日・診断名・画像など、個人を特定できる情報はすべて禁止です。

所属施設の情報システム部門・コンプライアンス担当に必ず事前確認した上で、「臨床疑問」(公開済みの研究テーマ)のみ入力してください。

Q5:AI文献検索のスキルは、どうやって身につければよいですか?

「PubMed→AI→PubMed」の往復を、毎週1回でも繰り返すことが最短ルートです。

まずPubMedで検索式を組み、ヒットした論文をAIで要約させ、再度PubMedで関連論文を探す。この往復で「AIが何を取り逃すか」「何を捏造するか」が体感的にわかります。

抄読会・症例検討の準備で実践するのが、最も効率的なトレーニングです。

本記事のまとめ

- AI文献検索ツールには7つの普遍的落とし穴があり、最大のリスクは「論文取り逃し91%」と「誤除外28%」

- PT・OTがAIを安全に使う鍵は、リスク階層化フレームワーク(低・中・高リスク)で工程ごとに人間判断を必須化すること

- BRAINでは「AIはセカンドレビュアー、最終判断はセラピスト」を運用ポリシーに据え、PMID実在確認・数値原文確認・施設内ピアレビューを必須化

- 「AIで下調べ→PubMedで網羅検索→人間が最終判断」が、2026年現在の最も科学的に支持される運用

本記事の内容が、AIの便利さと安全性を両立したいPT・OTの役に立てましたら幸いです。

参考文献

Clark J, Barton B, Albarqouni L, et al. Generative artificial intelligence use in evidence synthesis: a systematic review. Res Synth Methods. 2025. PMID: 41626912

Rashid M, Yi CS, Sathapanasiri T, et al. Role of generative artificial intelligence in assisting systematic review process in health research: a systematic review. Value Health. 2025. PMID: 40848037

Lau O, Golder S. Comparison of Elicit AI and traditional literature searching in evidence syntheses using four case studies. Cochrane Evid Synth Methods. 2025. PMID: 41035533

Bianchi J, Hirt J, Vogt M, et al. Data extractions using a large language model (Elicit) and human reviewers in randomized controlled trials: a systematic comparison. Cochrane Evid Synth Methods. 2025. PMID: 41019842

Helms Andersen T, Marcussen TM, Termannsen AD, et al. Using artificial intelligence tools as second reviewers for data extraction in systematic reviews: a performance comparison of two AI tools against human reviewers. Cochrane Evid Synth Methods. 2025. PMID: 40661122

Hempel S, Sysawang K, Holmer HK, et al. Using large language models to address contextual questions in systematic reviews. Cochrane Evid Synth Methods. 2026. PMID: 41767019

Gainey CS, Shroff H, Fix OK. Artificial intelligence tools for GI research: a practical guide. Clin Gastroenterol Hepatol. 2026. PMID: 41935592

Granjeiro JM, Cury AADB, Cury JA, et al. The future of scientific writing: AI tools, benefits, and ethical implications. Braz Dent J. 2025;36:e256471. PMID: 40197923

Apata OE, Kwok OM, Lee YH. The use of generative artificial intelligence in academic research: a review of the Consensus App. Cureus. 2025;17(7):e87297. PMID: 40755655

Njunge M, Huang Y, Li R, et al. Assessing the safety and clinical appropriateness of breast cancer advice from consumer-grade large language models. J Med Imaging Radiat Oncol. 2026. PMID: 41937254

Sibbesen JB, Trickett H, Yzaguirre S. An evaluation of six artificial intelligence tools for formulary management. J Am Coll Clin Pharm. 2026;9(2):e70172. PMID: 42009480

Liang Z, Mao J, Lu K, Li G. Finding citations for PubMed: a large-scale comparison between five freely available bibliographic data sources. Scientometrics. 2021;126(12):9519-9542. PMID: 34720252

Bernard N, Sagawa Y, Bier N. Using artificial intelligence for systematic review: the example of Elicit. BMC Med Res Methodol. 2025. PMID: 40102714

BRAINアカデミー

エビデンスに基づく脳卒中リハビリテーションを体系的・網羅的に学ぶ、3ヶ月間のオンライン学習プログラムです。①動画教材 ②課題 ③フィードバックを通じて、EBMを身に付けましょう!

詳細はこちら